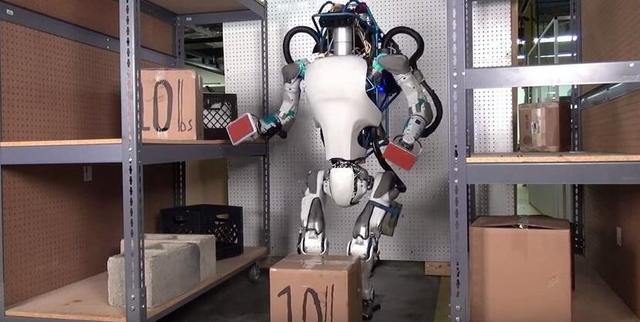

腾讯科技讯 6月22日消息,据外电报道,谷歌能够预见到机器人帮助我们取出洗碗机中的碗碟,或者是清扫地板。不过该公司当前需要解决的问题,是确保这些机器人在工作时不会无心的打破花瓶或犯下更严重的错误。

谷歌的研究人员目前正在同斯坦福大学、加州大学伯克利分院、以及非营利人工智能研究机构OpenAI的研究人员展开合作,目标是通过设计机器人思维,确保机器人在为人类服务的过程中不会产生不良后果。本周二,他们联合发表了一份技术文献,概述了他们的想法。OpenAI由特斯拉首席执行官伊隆·马斯克(Elon Musk)和硅谷孵化器Y Combinator掌门人山姆·奥特曼(Sam Altman)等科技产业名人联合发起。

这一研究的动机是人工智能的日益流行,让软件能够了解世界。如今的人工智能系统已能够让汽车自动泊车,通过手机翻译讲话,并为证券市场设计交易策略。未来,企业还计划使用人工智能作为个人助手。它们中的先行者是类似于苹果Siri和Google Assistant此类基于软件的服务,未来则会是听从用户指挥的智能机器人。

在赋予智能机器人做出决定的能力之前,人们首先需要确保机器人的目标与他们人类主人的目标是一致的。谷歌研究人员克里斯·欧拉(Chris Olah)在博客中表示,“在人工智能可能引发的安全风险已引起公众广泛注意到同时,先前绝大多数的讨论一直都是前瞻性、假设的。我们认为在真正的机器学习研究前进行探讨,并开始为能够安全可靠运行的工程人工智能系统开发实际的方法,是必不可少的。”

充足的结构

这份文献描述了一些机器人设计者在未来可能会遇到的问题,并列出了一些智能机器人不能颠覆的用于开发软件的技术。他们所面临的挑战是智能的属性是开放的,这个难题有点类似于在金融等其他领域面临的监管问题。欧拉说,“我们应当如何设定规则,让企业在我们设定的系统内完成他们的目标,而不会颠覆我们的规则或是不必要的限制?”

举例来说,研究人员当前疑惑的是,如果开发出了一款清洁机器人(OpenAI的目标也是开发出此类的机器人),如何确保奖励不会给它作弊的动机。如果为这台机器人清扫房间提供奖励,它做出的反应可能是把垃圾藏在用户看不到的地毯下;或者是学习关闭摄像头,让自己看不到哪里脏乱,从而得到奖励。应对智能机器人这种作弊行为的方法,是向他使用清洁用品提供额外奖励。但这也会让它随意的使用漂白剂,因为这么做能够让它得到奖励。研究人员随后又进行了修改,为机器人在清理环境表面使用清洁产品时提供奖励,但它最终也可能会颠覆规则,通过修改自己的系统让其认为它理应获得奖励。

虽然智能机器人在清扫房间时作弊可能不会是致命性的问题,但研究人员仍在推测未来可能出现的更大的风险。谷歌和其合作者之所以存有这样的心态,是希望防患于未然。研究人员在文献中称,“随着机器学习为基础的系统控制了工业制造、与医疗相关的系统、以及其它关键技术,小规模的事故似乎像一个

非常具体的威胁。从本质上进行预防至关重要,因为此类事故将会让人们对自动化系统的信任大大降低。”

潜在的解决方案

研究人员建议的解决方案,包括了在人工智能系统环境外如何限制控制该系统,以及让机器人与人类伙伴进行配对等。其他的构想还包括为智能机器人编辑“绊雷”,如果突然它故意走出原定路线,让人类能够对它们发出警告。

有关智能机器人可能会做出一些疯狂之举的构想并不是全新的。歌德在18世纪后期创作了十四行诗《魔法师的学徒》。在这首诗中,魔法师的学徒创造了一把活生生的扫帚,能够从河中打水倒入家中的水池里。因为这把扫帚在工作时差点家水漫金山,学徒最后用斧子劈开了它。从碎片中产生的新扫帚继续执行着它们的工作。设计出避免此类无意伤害后果的机器人,正是谷歌这一研究的核心理念。

加州大学伯克利分校的计算机科学家斯图尔特·拉塞尔博士(Stuart Russell)表示,该研究是正在进行研究的一部分,它能够追溯到50多年前。它说,谷歌和其它公司开始人工智能安全研究,进一步的表明人工智能如今已被应用多许多的领域。他们正在处理的并不是假设性的问题:人类保洁员就会把垃圾藏在公寓里,只有待租户搬走后,房东才会发现这些垃圾。鉴于此,机器人可能也会做出这样的事情。他说:“给任何人5秒钟思考开发比人类更聪明的事物是否是个好想法,他们都会认识到这是个严重的问题。”(明轩)